Verberg uw foto’s met deze AI-privacytool om gezichtsherkenning voor de gek te houden

Alomtegenwoordige gezichtsherkenning vormt een ernstige bedreiging voor de privacy. Het idee dat de foto’s die we delen, door bedrijven wordt verzameld om algoritmen te trainen die commercieel worden verkocht, is zorgwekkend. Iedereen kan deze tools kopen, een foto van een vreemde maken en binnen enkele seconden zien wie ze zijn. Maar onderzoekers hebben een slimme manier bedacht om dit probleem te helpen bestrijden.

De oplossing is een tool genaamd Fawkes en is gemaakt door wetenschappers van het Sand Lab van de University of Chicago. Vernoemd naar de Guy Fawkes-maskers die door revolutionairen in het stripboek en de film V for Vendetta zijn opgezet, gebruikt Fawkes kunstmatige intelligentie om je foto’s subtiel en bijna onmerkbaar te veranderen om gezichtsherkenningssystemen te misleiden.

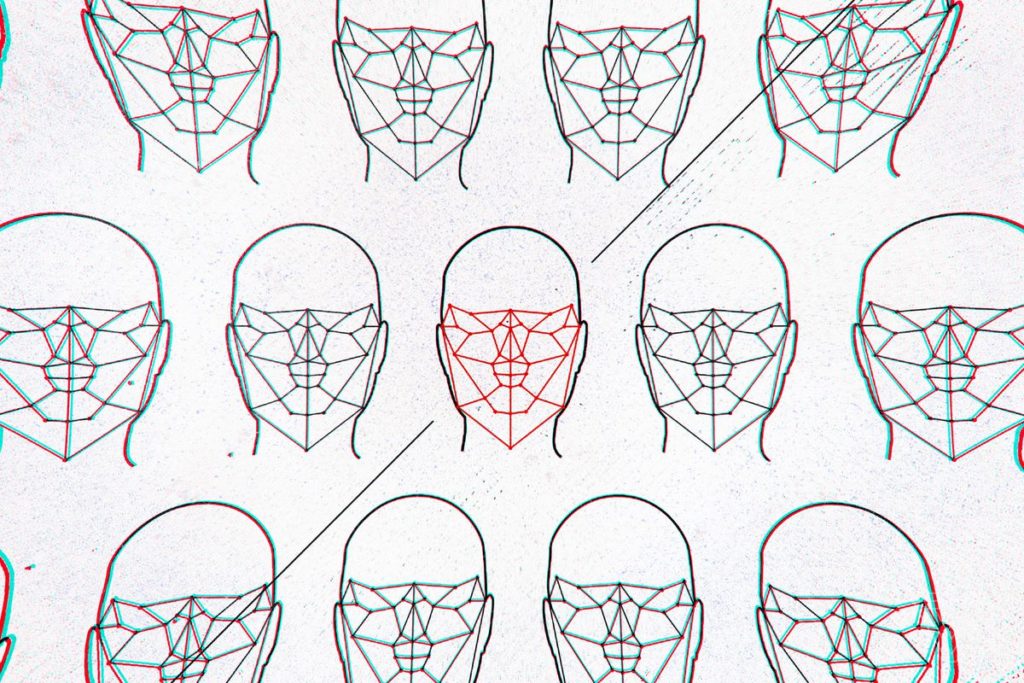

FAWKES OP JE FOTO’S DRAAIEN IS ALS HET TOEVOEGEN VAN EEN ONZICHTBAAR MASKER AAN JE SELFIES

De manier waarop de software werkt, is een beetje ingewikkeld. Je foto’s door Fawkes laten lopen, maakt je niet onzichtbaar voor gezichtsherkenning. In plaats daarvan brengt de software subtiele wijzigingen aan in uw foto’s, zodat elk algoritme dat deze afbeeldingen in de toekomst scant, u helemaal als een ander persoon ziet. In wezen is het uitvoeren van Fawkes op je foto’s als het toevoegen van een onzichtbaar masker aan je selfies.

Wetenschappers noemen dit proces ‘cloaking’ en het is bedoeld om de middelen die gezichtsherkenningssystemen nodig hebben om te functioneren, te beschadigen: databases met gezichten die van sociale media zijn verwijderd. Gezichtsherkenningsbedrijf Clearview AI beweert bijvoorbeeld ongeveer drie miljard afbeeldingen van gezichten te hebben verzameld van sites zoals Facebook, YouTube en Venmo, die het gebruikt om vreemden te identificeren. Maar als de foto’s die je online deelt door Fawkes zijn gegaan, zeggen de onderzoekers, dan is het gezicht waarvan de algoritmen weten dat het niet echt van jou is.

Volgens het team van de University of Chicago is Fawkes 100 procent succesvol tegen de modernste gezichtsherkenningsdiensten van Microsoft (Azure Face), Amazon (Rekognition) en Face ++ van de Chinese techgigant Megvii.

“Wat we doen is de verhulde foto in wezen gebruiken als een Trojaans paard, om ongeautoriseerde modellen te corrumperen om het verkeerde te leren over hoe je op jezelf lijkt en niet op iemand anders”, Ben Zhao, hoogleraar informatica aan de universiteit van Chicago, die hielp bij het maken van de Fawkes-software, vertelde The Verge . “Zodra de corruptie zich voordoet, ben je continu beschermd, waar je ook heen gaat of wordt gezien.”

Je herkent haar nauwelijks. Foto’s van koningin Elizabeth II voor (links) en nadat (rechts) door Fawkes cloaking-software is gelopen. Afbeelding: The Verge

De groep achter het werk – Shawn Shan, Emily Wenger, Jiayun Zhang, Huiying Li, Haitao Zheng en Ben Y. Zhao – publiceerde eerder dit jaar een paper over het algoritme . Maar eind vorige maand brachten ze Fawkes ook uit als gratis software voor Windows en Macs die iedereen kan downloaden en gebruiken. Tot op heden zeggen ze dat het meer dan 100.000 keer is gedownload.

In onze eigen tests ontdekten we dat Fawkes dun is in zijn ontwerp, maar gemakkelijk genoeg om toe te passen. Het duurt een paar minuten om elk beeld te verwerken en de wijzigingen die het aanbrengt, zijn meestal onmerkbaar. Eerder deze week publiceerde The New York Times een verhaal over Fawkes waarin werd opgemerkt dat het verhullende effect vrij duidelijk was, waarbij vaak geslachtsgebonden veranderingen in afbeeldingen werden aangebracht, zoals het geven van snorren aan vrouwen. Maar het Fawkes-team zegt dat het bijgewerkte algoritme veel subtieler is, en de eigen tests van The Verge zijn het hiermee eens.

HOEVEEL VERSCHIL KAN EEN TOOL ALS FAWKES MAKEN?

Maar is Fawkes een zilveren kogel voor privacy? Het is twijfelachtig. Om te beginnen is er het probleem van adoptie. Als je dit artikel leest en besluit om Fawkes te gebruiken om foto’s die je in de toekomst uploadt naar sociale media te camoufleren, zul je zeker in de minderheid zijn. Gezichtsherkenning is zorgwekkend omdat het een trend voor de hele samenleving is en daarom moet de oplossing ook voor de hele samenleving gelden. Als alleen de technisch onderlegde hun selfies afschermt, creëert het alleen maar ongelijkheid en discriminatie.

Ten tweede hebben veel bedrijven die algoritmen voor gezichtsherkenning verkopen lang geleden hun databases met gezichten gemaakt, en u kunt die informatie niet met terugwerkende kracht terugnemen. De CEO van Clearview, Hoan Ton-That, vertelde de Times hetzelfde. “Er zijn miljarden ongewijzigde foto’s op internet, allemaal op verschillende domeinnamen”, zegt Ton-That. “In de praktijk is het vrijwel zeker te laat om een technologie als Fawkes te perfectioneren en op grote schaal in te zetten.”

Vergelijkingen van ongeklede en verhulde gezichten met Fawkes. Afbeelding: SAND Lab, University of Chicago

Maar natuurlijk is het team achter Fawkes het niet eens met deze beoordeling. Ze merken op dat hoewel bedrijven zoals Clearview beweren miljarden foto’s te hebben, dat niet veel betekent als je bedenkt dat ze honderden miljoenen gebruikers zouden moeten identificeren. “De kans is groot dat Clearview voor veel mensen slechts een zeer klein aantal openbaar toegankelijke foto’s heeft”, zegt Zhao. En als mensen in de toekomst meer verhulde foto’s uitbrengen, zegt hij, zal het aantal verhulde afbeeldingen vroeg of laat groter zijn dan de niet-verhulde afbeeldingen.

Op het gebied van adoptie geeft het Fawkes-team echter toe dat hun software, om een echt verschil te maken, op grotere schaal moet worden vrijgegeven. Ze zijn niet van plan om een web- of mobiele app te maken vanwege beveiligingsproblemen, maar hopen dat bedrijven zoals Facebook in de toekomst vergelijkbare technologie in hun eigen platform kunnen integreren.

Het integreren van deze technologie zou in het belang zijn van deze bedrijven, zegt Zhao. Bedrijven zoals Facebook willen tenslotte niet dat mensen stoppen met het delen van foto’s, en deze bedrijven zouden nog steeds de gegevens die ze nodig hebben uit afbeeldingen kunnen verzamelen (voor functies zoals fototagging) voordat ze ze op het openbare web camoufleren. En hoewel het integreren van deze technologie nu slechts een klein effect kan hebben voor huidige gebruikers, zou het toekomstige, privacybewuste generaties kunnen overtuigen om zich aan te melden bij deze platforms.

“Adoptie door grotere platforms, zoals Facebook of anderen, kan op den duur een verlammend effect hebben op Clearview door [hun technologie] in feite zo ineffectief te maken dat het niet langer nuttig of financieel levensvatbaar zal zijn als een service”, zegt Zhao. “Clearview.ai failliet gaan omdat het niet langer relevant of nauwkeurig is, is iets waar we tevreden mee zouden zijn als resultaat van ons werk.”